Программа SiteAnalyzer предназначена для анализа сайта и выявления технических ошибок (поиск битых ссылок, дубликатов страниц, некорректных ответов сервера), а также ошибок и недоработок в SEO-оптимизации (незаполненные мета-теги, избыток либо полное отсутствие заголовков страниц H1, анализ контента страницы, качество перелинковки и множество других SEO-параметров). Всего анализируется более 60 параметров.

Основные возможности

- Сканирование всех страниц сайта, а также изображений, скриптов и документов

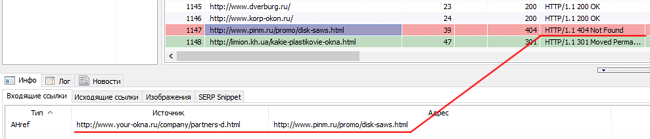

- Получение кодов ответа сервера для каждой страницы сайта (200, 301, 302, 404, 500, 503 и т.д.)

- Определение наличия и содержимого Title, Keywords, Description, H1-H6

- Поиск и отображение «дубликатов» страниц, мета-тегов и заголовков

- Определение наличия атрибута rel=«Canonical» для каждой страницы сайта

- Следование директивам файла «Robots.txt», мета-тега «Robots», либо «X-Robots-Tag»

- Учет «Noindex» и «Nofollow» при обходе страниц сайта

- Скрейпинг данных с помощью XPath, CSS, XQuery, RegEx

- Проверка уникальности контента внутри сайта

- Проверка скорости загрузки страниц по Google PageSpeed

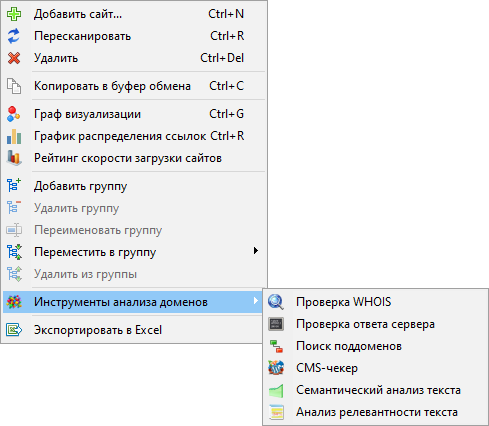

- Анализ доменов (проверка WHOIS, CMS-чекер, поиск поддоменов, плотность ключей и т.п.)

- Ссылочный анализ: определение внутренних и внешних ссылок для любой страницы сайта

- Расчет внутреннего показателя PageRank для каждой страницы сайта

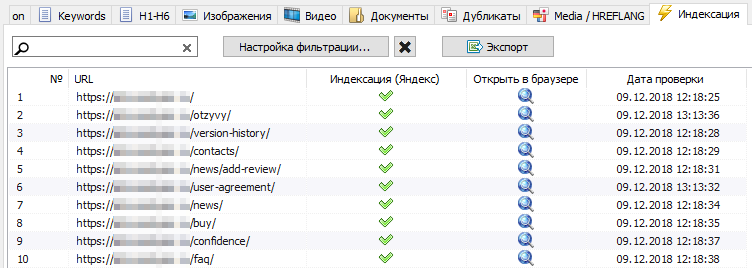

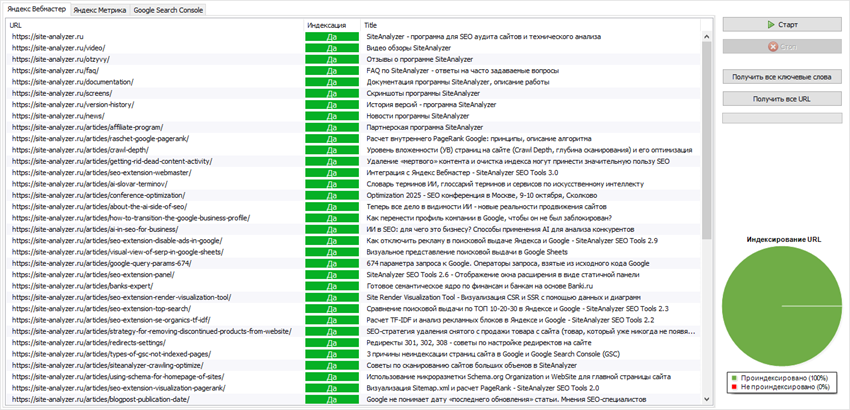

- Проверка индексации страниц сайта в поисковой системе Яндекс

- Визуализация структуры сайта на графе

- Поиск и отображение цепочек редиректов

- Сканирование произвольных URL и внешних Sitemap.xml

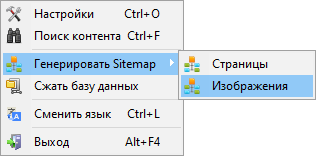

- Генерация карты сайта Sitemap.xml (с возможностью разбиения на несколько файлов)

- Фильтрация данных по любому параметру

- Поиск произвольного контента на сайте

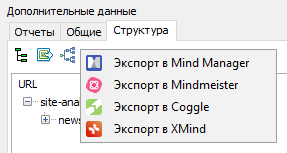

- Экспорт структуры сайта в MindMap

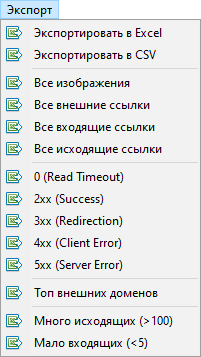

- Экспорт отчетов в CSV, Excel и PDF-формат

Отличия от аналогов

- SiteAnalyzer – это полностью российская разработка

- Низкие требования к ресурсам компьютера, малый расход оперативной памяти

- Сканирование сайтов практически любых объемов

- Быстрое переключение между проектами

- Оперативная техподдержка

Разделы документации

- Установка программы

- Начало работы

- Настройки программы

- Основные настройки

- Сканирование

- SEO

- Виртуальный Robots.txt

- Проверка индексации

- User-Agent

- Произвольные HTTP-заголовки

- Proxy-сервер

- Исключить URL

- Следовать URL

- PageRank

- Авторизация

- Аналитика new

- White Label

- Работа с программой

- Настройка столбцов и вкладок

- Фильтрация данных

- Техническая статистика сайта

- Статистика SEO

- Custom Filters

- Custom Search

- Анализ доменов

- Скрейпинг данных

- Проверка уникальности контента

- Проверка скорости загрузки страниц

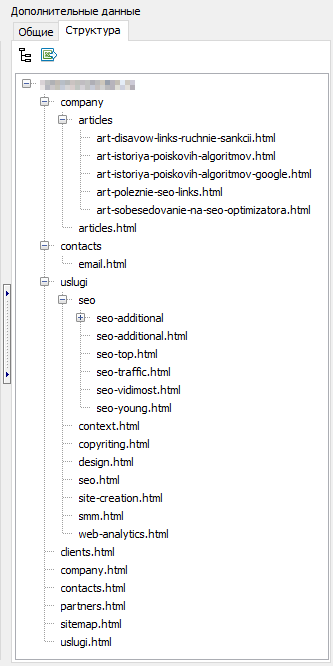

- Структура сайта

- Контекстное меню списка проектов

- Граф визуализации

- График распределения ссылок

- График скорости загрузки страниц

- ТОП анкоров

- Экспорт в MindMap

- Генерация Sitemap.xml

- Виртуальное сканирование сайтов

- Сканирование произвольных URL

- Дашборд

- Импорт URL

- Экспорт данных

- Мультиязычность

- Дефрагментация данных

- Тарифы

Установка программы

Инструкция по установке:

- Скачайте дистрибутив 64 или 32-бит версии в зависимости от типа вашей ОС Windows.

- Запустите инсталлятор.

- Следуйте инструкциям программы установки.

- Установка завершена.

Портативная версия:

- После того, как вы установили SiteAnalyzer из дистрибутива на свой ПК, просто скопируйте папку программы на флешку, либо другой съемный носитель и запускайте напрямую файл «SiteAnalyzer.exe».

- Теперь программа будет прикреплена к основному ПК изначально, а при запуске на другом ПК в личном кабинете на сайте программы нужно будет удалить «старое» устройство и ввести ключ на новом.

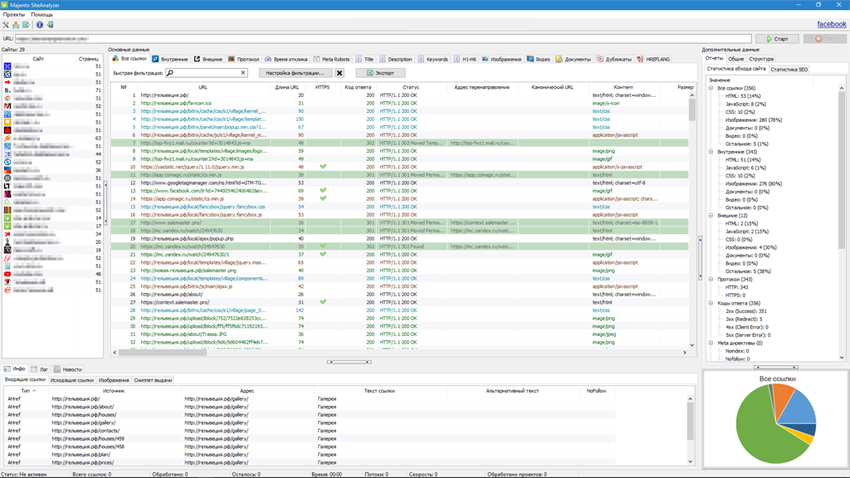

Начало работы

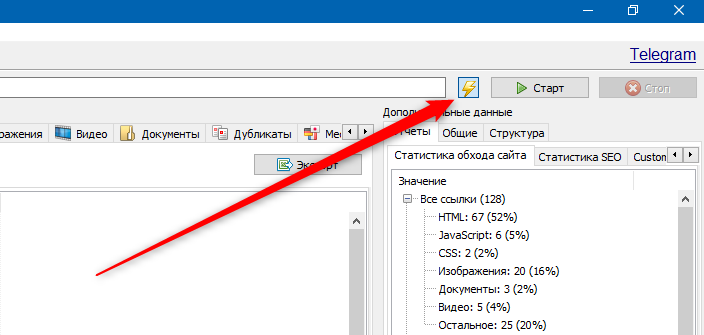

При запуске программы пользователю доступна адресная строка для ввода URL анализируемого сайта, в которой можно ввести любую страницу сайта, после чего поисковый робот, пройдя по ссылкам исходной страницы, обойдет весь сайт, в том числе и главную страницу.

- После нажатия кнопки "Старт", поисковый робот начинает переобход всех страниц сайта по внутренним ссылкам. На внешние ресурсы он не переходит, также краулер не переходит по ссылкам, выполненным на JavaScript.

- После того, как робот обойдет все страницы сайта, становится доступным отчет, выполненный в виде таблицы и отображающий полученные данные, сгруппированные по тематическим вкладкам.

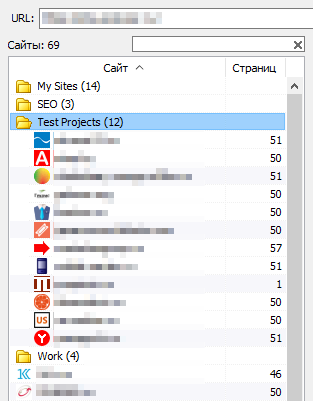

Все анализируемые проекты отображаются в левой части программы и автоматически сохраняются в базе программы вместе с полученными данными. Для удаления ненужных сайтов воспользуйтесь контекстным меню списка проектов.

Примечание:

- При нажатии на кнопку "Пауза" сканирование проекта приостанавливается, параллельно текущий прогресс сканирования сохраняется в базу, что позволяет, например, закрыть программу и продолжить сканирование проекта после перезапуска программы с места остановки.

- Кнопка "Стоп" прерывает сканирование текущего проекта без возможности продолжения его сканирования.

Настройки программы

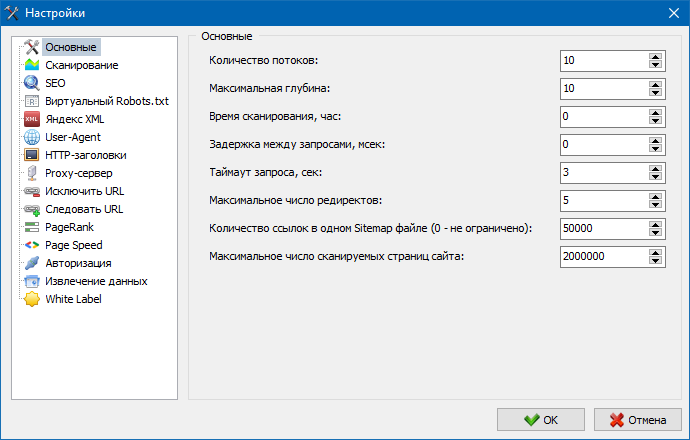

Раздел главного меню "Настройки" предназначен для тонких настроек работы программы с внешними сайтами и содержит 15 вкладок:

Раздел основных настроек служит для указания программе пользовательских директив, используемых при сканировании сайта.

Описание параметров:

- Количество потоков

- Чем больше число потоков, тем больше URL сможет обработать в единицу времени. При этом нужно учитывать, что большее число потоков ведет к большему числу используемых ресурсов ПК. Рекомендуется устанавливать число потоков в диапазоне 10-15.

- Время сканирования

- Служит для установки ограничения сканирования сайта по времени. Измеряется в часах.

- Максимальная глубина

- Данный параметр служит для указания глубины сканирования сайта. Главная страница сайта имеет уровень вложенности = 0. Например, если нужно просканировать страницы сайта вида "somedomain.ru/catalog.html" и "somedomain.ru/catalog/tovar.html", то в таком случае необходимо выставить значение максимальной глубины = 2.

- Задержка между запросами

- Служит для установки пауз при обращениях краулера к страницам сайта. Это бывает необходимо для сайтов на "слабых" хостингах, не выдерживающих больших нагрузок и частых к ним обращений.

- Таймаут запроса

- Установка времени ожидания ответа сайта на запрос программы. Если какие-то из страниц сайта отвечают медленно (долго грузятся), то сканирование сайта может занять достаточно длительное время. Такие страницы можно отсечь, указав значение, после которого сканер перейдет к сканированию остальных страниц сайта и тем самым не будет задерживать общий прогресс.

- Число сканируемых страниц сайта

- Ограничение на максимальное число сканируемых страниц. Бывает полезно, если, например, вам нужно просканировать первые Х страниц сайта (при этом не учитываются изображения, файлы стилей, скрипты и прочие типы файлов).

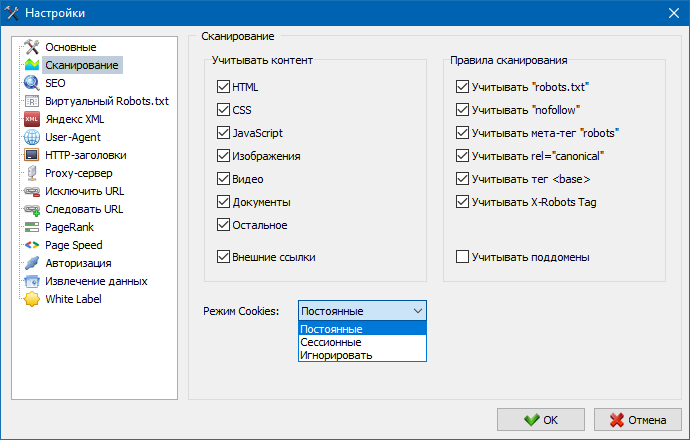

Учитывать контент

- В данном разделе можно выбрать типы данных, которые будут учитываться парсером при обходе страниц (изображения, видео, стили, скрипты), либо исключить лишнюю информацию при парсинге.

Правила сканирования

- Данные настройки связаны с настройками исключений при обходе сайта краулером используя файл "robots.txt", по ссылкам типа "nofollow", а также используя директивы "meta name='robots'" непосредственно в коде страниц сайта.

Режим Cookies

- В программе SiteAnalyzer имеется 3 варианта использования файлов cookie:

- Постоянное – выбирайте этот пункт, если доступ к сайту закрыт для обращений без файлов cookie. Также полезно, чтобы все запросы учитывались в рамках одной сессии, так как при выключенной настройке каждый новый запрос будет создавать новую сессию.

- Сессионное – в данном случае каждый новый запрос к сайту будет создавать новую сессию.

- Игнорировать – запрет использования cookie.

- Мы рекомендуем использовать первый пункт, так как он является наиболее распространенным и позволяет более уверенно сканировать большинство сайтов в сети.

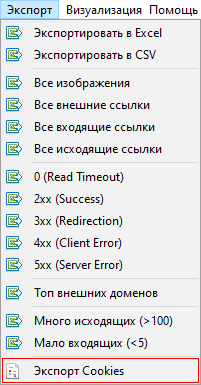

- Также есть возможность экспорта списка всех файлов cookie активного сайта в текстовый файл при помощи кнопки «Экспорт Cookies» через главное меню программы.

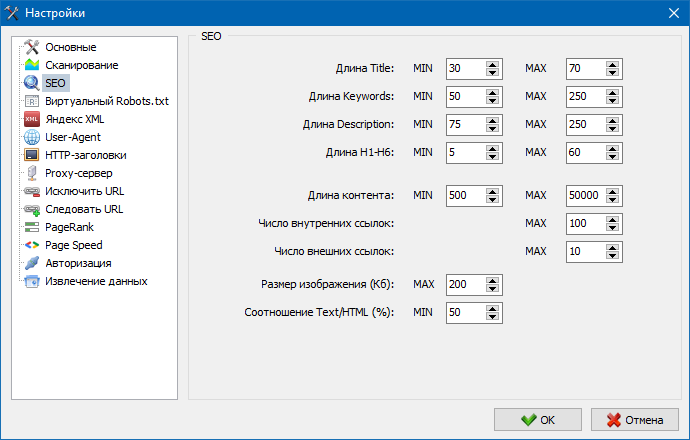

Данный раздел служит для указания основных анализируемых SEO-параметров, которые в дальнейшем будут проверяться на корректность при парсинге страниц, после чего полученная статистика будет отображена на вкладке «Статистика SEO» в правой части главного окна программы.

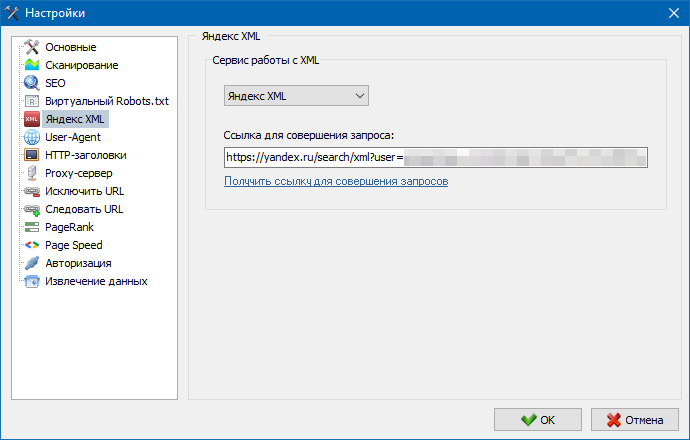

При помощи данных настроек можно выбрать сервис, посредством которого будет производиться проверка индексации страниц в поисковой системе Яндекс. Имеется 6 (шесть) вариантов проверки индексации: при помощи сервиса Яндекс Search API, сервиса Majento.ru, а также сервисов XMLProxy, XMLRiver, XMLStock, SERPriver.

При выборе сервиса «Яндекс Search API» нужно учитывать ограничения, которые могут быть применены при проверке индексации страниц, относительно имеющегося баланса на вашем аккаунте Яндекса, в результате чего часто могут возникать ситуации, когда лимитов вашего аккаунта не будет хватать для проверки всех страниц за один раз.

При использовании сторонних сервисов почасовые либо ежедневные ограничения практически отсутствуют, так как ваш лимит буквально вливается в общий пул лимитов, который сам по себе не мал, а также имеет значительно больший лимит при почасовых ограничениях, нежели любой из отдельных пользовательских аккаунтов на «Яндекс Search API».

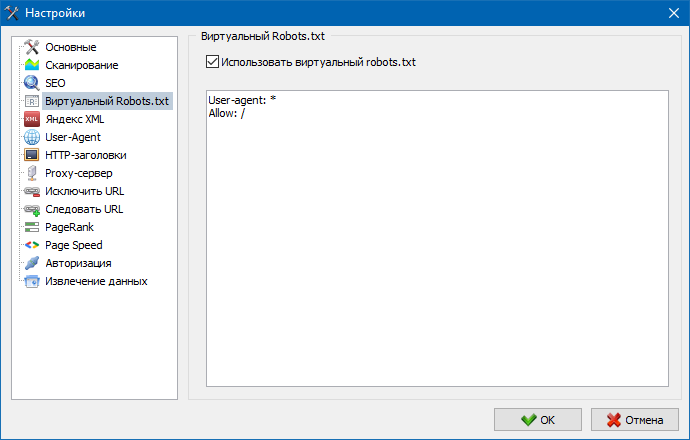

Виртуальный robots.txt можно использовать вместо реального robots.txt, размещенного на сайте.

Это бывает удобно при тестировании сайта, когда, например, нужно просканировать определенные разделы сайта, закрытые от индексации (либо наоборот – не учитывать их при сканировании), при этом не нужно физически вносить изменения в реальный robots.txt и тратить на это время разработчика.

Виртуальный Robots.txt хранится в настройках программы и является общим для всех проектов.

Примечание: при импорте списка URL учитываются директивы виртуального robots.txt (если эта опция активирована), иначе никакой robots.txt для списка URL не учитывается.

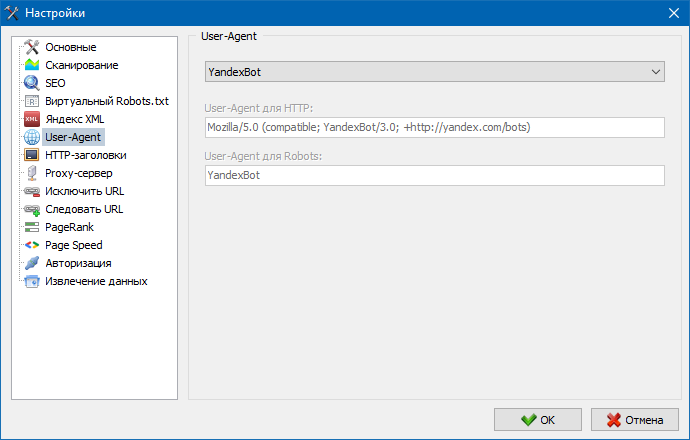

В разделе User-Agent можно указать, каким юзер-агентом будет представляться программа при обращении к внешним сайтам во время их сканирования.

По умочанию, установлен юзер-агент «SiteAnalyzerbot», однако, при необходимости, можно выбрать один из стандартных агентов, наиболее часто встречающихся в интернет. Среди них есть такие, как:

- Боты поисковых систем YandexBot, GoogleBot, Microsoft Edge.

- Боты браузеров Chrome, Firefox, IE8.

- А также мобильных устройств iPhone, Android и многие другие.

Также можно установить пользовательский User-Agent с произвольным именем.

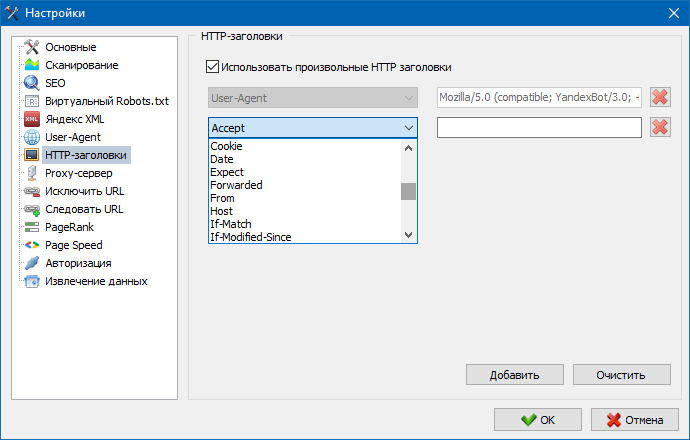

При помощи данной опции можно анализировать реакцию сайта и страниц на разные запросы. Например, кому-то может понадобиться отдавать в запросе Referer, владельцам мультиязычных сайтов захочется передавать Accept-Language|Charset|Encoding, а у кого-то есть потребность в передаче необычных данных в заголовках Accept-Encoding, Cache-Control, Pragma и т.п.

Примечание: заголовок User-Agent настраивается на отдельной вкладке настроек "User-Agent".

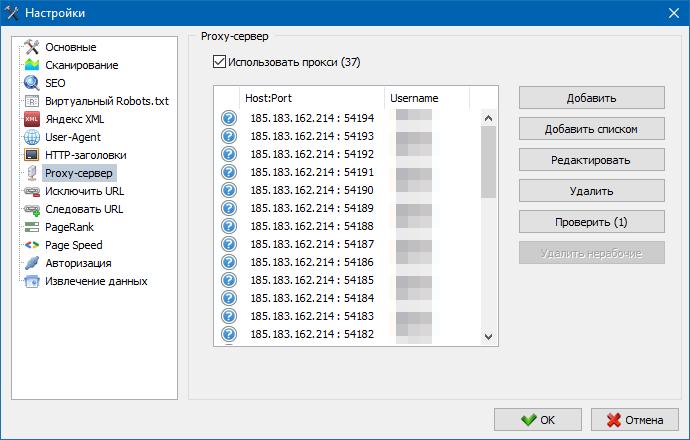

Если есть необходимость работать через прокси, то в данном разделе вы можете добавить список прокси-серверов, через которые программа будет обращаться к внешним ресурсам. Дополнительно, имеется возможность проверки прокси на работоспособность, а также функция удаления неактивных прокси-серверов.

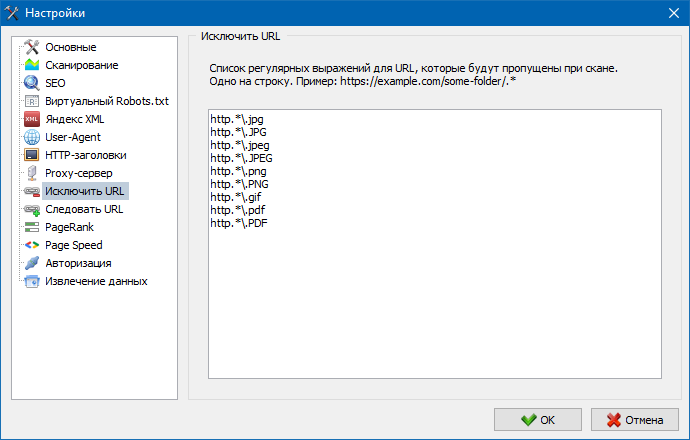

Данный раздел предназначен для исключения обхода определенных страниц и разделов сайта при парсинге.

При помощи регулярных выражений (RegEx) можно указать, какие разделы сайта не должны обходиться краулером и, соответственно, не должны попасть в базу программы. Данный список является локальным списком исключений на время сканирования сайта (относительно него "глобальным" списком является файл "robots.txt" в корне сайта).

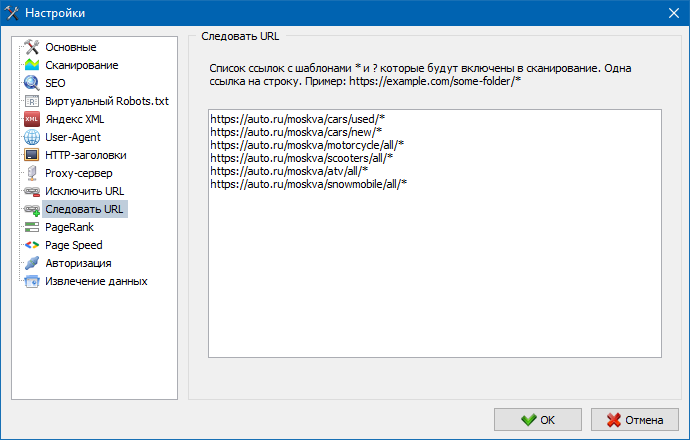

Аналогично позволяет добавлять URL, которые должны быть обязательно просканированы. При этом все остальные URL, за пределами этих папок, во время сканирования будут проигнорированы. Данная опция также работает при помощи регулярных выражений.

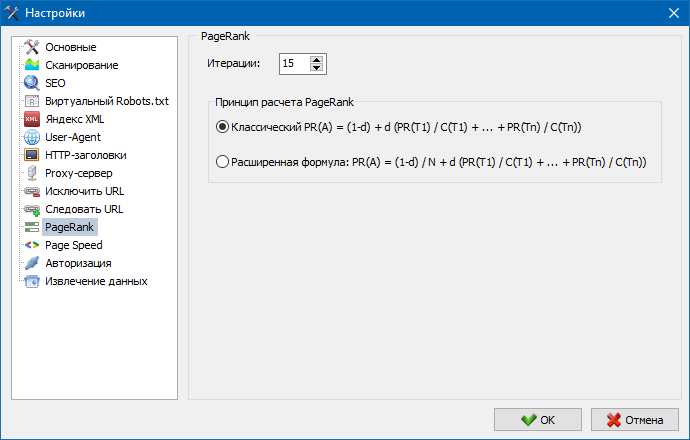

При помощи параметра PageRank можно анализировать навигационную структуру ваших сайтов, а также оптимизировать систему внутренних ссылок веб-ресурса для передачи ссылочного веса наиболее важным страницам.

В программе доступно два варианта расчета PageRank: классический алгоритм и его более современный аналог. В целом, для анализа внутренней перелинковки сайта нет большой разницы при использовании первого или второго алгоритмов, поэтому вы можете использовать любой алгоритм из двух предложенных.

Подробное описание алгоритма и принципы расчета PageRank читайте в статье Расчет внутреннего PageRank.

Ввод логина и пароля для автоматической авторизации на страницах, закрытых через .htpasswd и защищенных BASIC авторизацией сервера.

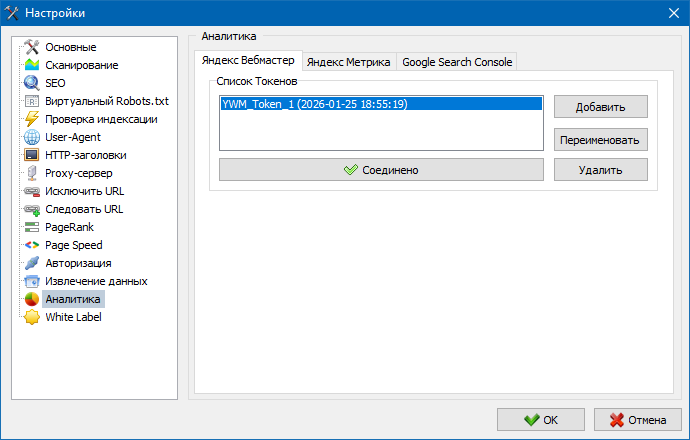

Интеграция программы с системами аналитики Яндекс и Google (Яндекс Вебмастер, Яндекс Метрика, Google Search Console) позволяет получать информацию об индексации страниц сайта, анализировать количество поступающего трафика на эти страницы, узнавать показатель отказов по URL, получить глубину просмотра, узнавать статус индексации страниц, получать список запросов, по которым ранжируется та или иная страница и выгружать все эти данные в Excel.

Подробное описание работы с модулем аналитики читайте в статье SiteAnalyzer 3.3.

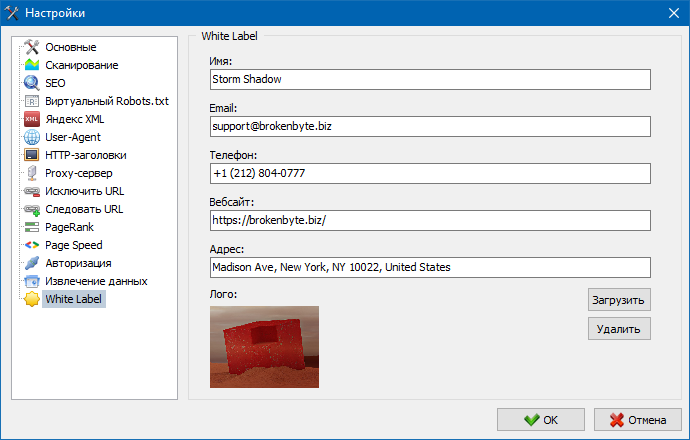

White Label – это возможность создания брендированных отчетов с собственными логотипами и контактными данными для более презентабельного представления аудитов сайта вашим клиентам.

По умолчанию, в отчетах отображаются дефолтные контакты и логотип SiteAnalyzer, однако теперь их можно заменить на собственные данные.

Для этого необходимо в настройках программы нужно выбрать пункт "White Label" и заполнить информацию о вашей организации: логотип, email, телефон, адрес, сайт и название организации.

Более подробно ознакомиться с работой пункта "White Label" можно в обзорной статье SiteAnalyzer 2.7.

Работа с программой

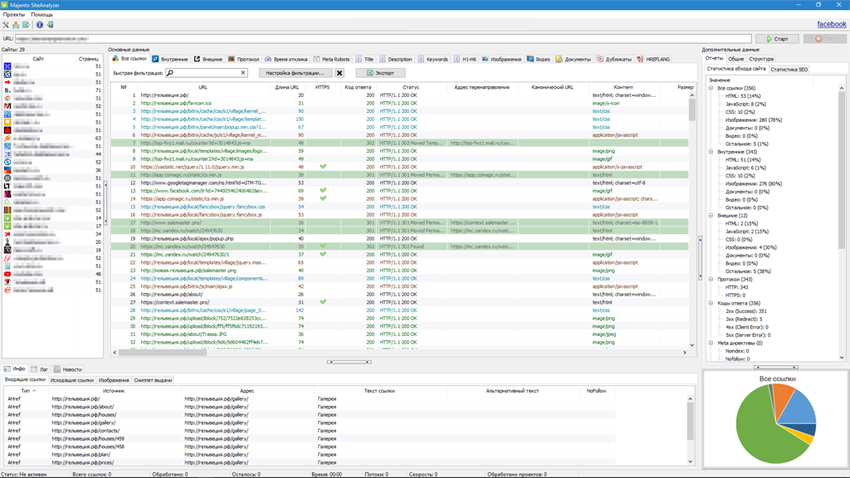

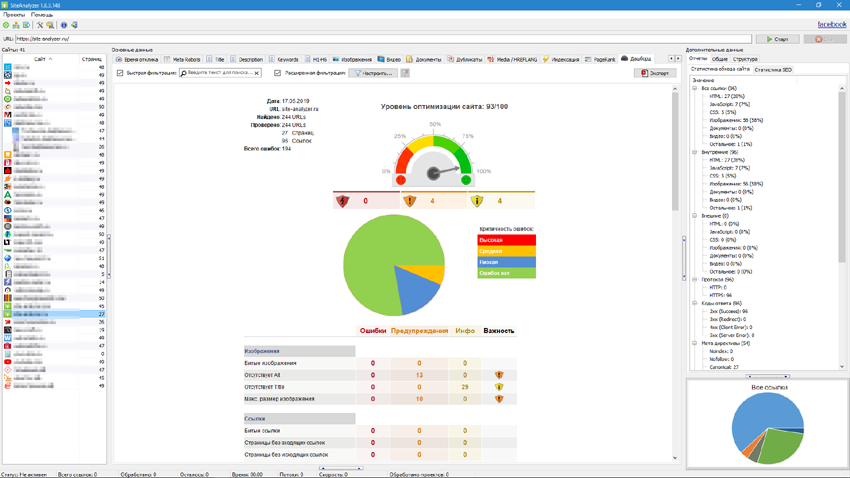

После завершения сканирования пользователю становится доступна информация, размещенная в блоке "Основные данные". Каждая вкладка содержит данные, сгруппированные относительно их названий (например, вкладка "Title" содержит содержимое заголовков страниц <title></title>, вкладка "Изображения" содержит список всех изображений сайта и так далее). С помощью этих данных можно проводить анализ содержимого сайта, находить "битые" ссылки или некорректно заполненные мета-теги.

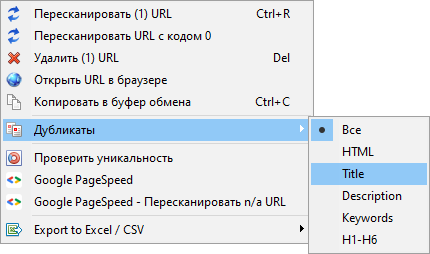

При необходимости (например, после внесения изменений на сайте) с помощью контекстного меню имеется возможность пересканирования отдельных URL для отображения изменений в программе.

С помощью этого же меню можно отображать дубликаты страниц по соответствующим параметрам (дубли title, description, keywords, h1, h2, контент страниц).

Пункт "Пересканировать URL с кодом 0" предназначен для автоматической перепроверки всех страниц, отдающих код ответа 0 (Read Timeout). Данный код ответа обычно отдается, когда сервер не успевает отдавать контент и соединение закрывается по таймауту, соответственно, страница не может быть загружена и информация из нее не может быть извлечена.

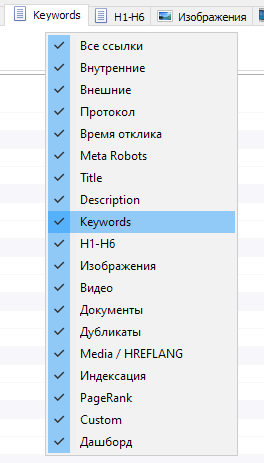

Теперь можно выбрать, какие вкладки будут отображаться в интерфейсе основных данных (наконец, стало возможным попрощаться с морально устаревшей вкладкой Meta Keywords). Это бывает удобно, если табы не умещаются на экране, либо вы редко их используете.

Столбцы также можно скрывать либо перемещать в нужное место путем перетаскивания.

Отображение табов и столбцов можно настроить с помощью вызова контекстного меню на панели основных данных. Перенос колонок осуществляется посредством мыши.

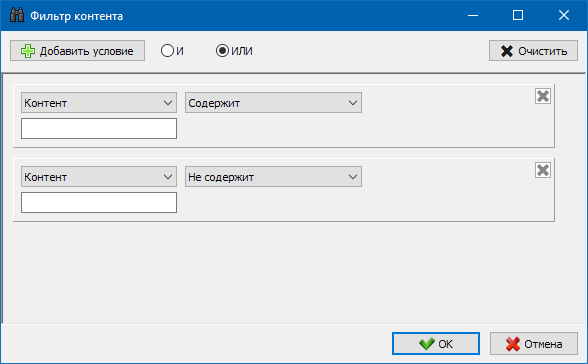

Для более удобного анализа статистики сайта в программе доступна фильтрация данных. Фильтрация возможна в двух вариантах:

- по любым полям при помощи "быстрого" фильтра

- с использованием настраиваемого фильтра (при помощи расширенных настроек выборки данных)

Быстрый фильтр

Используется для быстрой фильтрации данных и применяется одновременно ко всем полям текущей вкладки.

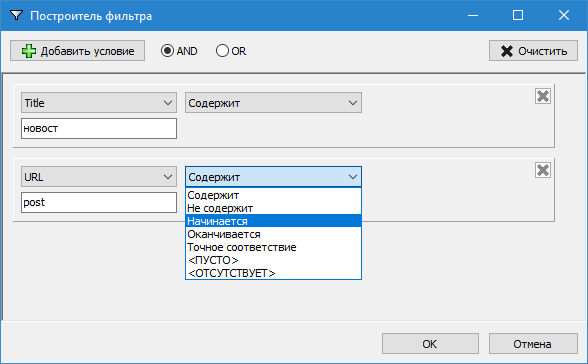

Настраиваемый фильтр

Предназначен для подробной фильтрации и может содержать одновременно несколько условий. Например, для мета-тега "title" вы ходите отфильтровать страницы по их длине, чтобы он не превышал 70 символов и одновременно содержал текст "новости". Тогда данный фильтр будет выглядеть так:

Таким образом, применяя настраиваемый фильтр к любой из вкладок вы можете получать выборки данных любой сложности.

Вкладка технической статистики сайта находится на панели "Дополнительные данные" и содержит набор основных технических параметров сайта: статистика по ссылкам, мета-тегам, кодам ответов страниц, параметрам индексации страниц, типам контента и т.п. параметрам.

Кликая по одному из параметров они автоматически отфильтровываются в соответствующей вкладке основных данных сайта, а также одновременно отображается статистика на диаграмме в нижней части страницы.

Вкладка SEO-статистики предназначена для проведения полноценных аудитов сайта и содержит 50+ основных SEO-параметров и определяет более 60 ключевых ошибок внутренней оптимизации! Отображение ошибок делится на группы, которые, в свою очередь, содержат наборы анализируемых параметров и фильтры, выявляющие ошибки на сайте.

Для всех результатов фильтрации есть возможность их быстрого экспорта в Excel без дополнительных диалогов (отчет сохраняется в папке с программой).

С более подробным описанием всех проверяемых параметров можно ознакомиться в этой статье.

На данной вкладке размещаются предустановленные фильтры, позволяющие создавать выборки по всем внешним ссылкам, ошибкам 404, изображениям и другим параметрам со всеми страницами, на которых они присутствуют. Таким образом, теперь вы можете легко и быстро получить список внешних ссылок и страниц, на которых они размещены, либо выбрать все битые ссылки и сразу увидеть, на каких страницах они расположены.

Все отчеты доступны в программе в режиме онлайн и отображаются на вкладке "Custom" панели основных данных. Дополнительно, есть возможность их экспорта в Excel через главное меню.

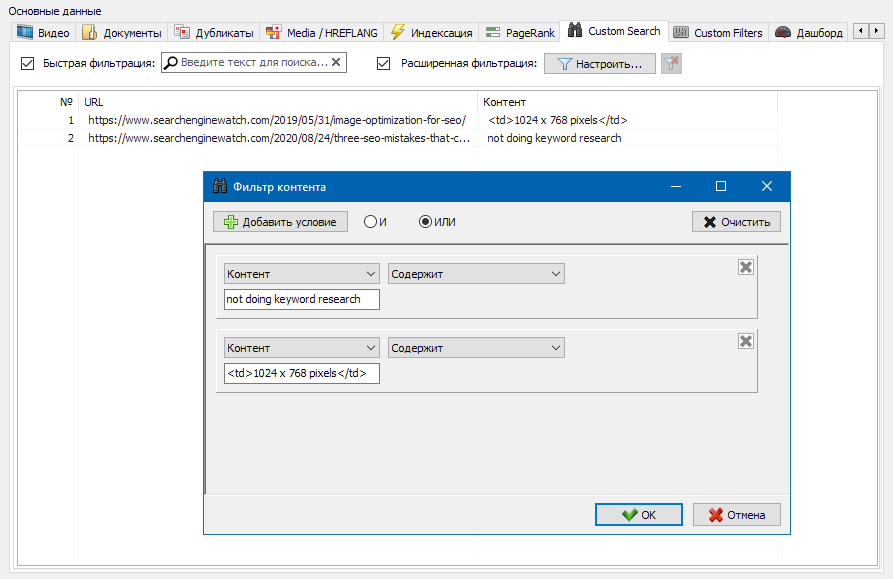

Функция поиска контента на сайте позволяет производить поиск по исходному коду и отображать веб-страницы, содержащие искомый контент.

Модуль настраиваемых фильтров позволяет проверить наличие на сайте микроразметки, мета-тегов, систем аналитики, фрагментов произвольного текста либо HTML-кода.

В окне конфигурации фильтра есть несколько параметров для поиска определенных фрагментов текста на страницах сайта, либо, наоборот, для исключения из результатов поиска страниц, содержащих определенный текст либо фрагменты HTML-кода (данная функция аналогична поиску контента в исходном коде страницы по Ctrl-F).

Набор из 6 модулей для анализа доменов (проверка WHOIS, CMS-чекер, поиск поддоменов, плотность ключей и т.п.). Модули вызываются через контекстное меню списка проектов.

Список модулей:

- Проверка WHOIS

- Инструмент предназначен для массового определения возраста доменов и их основных параметров. Наш WHOIS-чекер поможет массово определить возраст доменов в годах, отобразить WHOIS данные, имя регистратора домена, даты их создания и окончания регистрации, NS-сервера, IP-адрес, название организации владельца домена, а также контактный Email (если указан).

- Проверка ответа сервера

- С помощью данного модуля можно проверить, какой код ответа возвращает сервер при обращении к одной из его страниц. Для обычных страниц должен возвращаться код HTTP 200 (ОК), для несуществующих страниц этот код должен быть равен значению 404 (Not found). Также существуют и другие коды ответа сервера, такие как: 301, 403, 500, 503 и т.п.

- Поиск поддоменов

- Инструмент предназначен для поиска поддоменов определенного сайта. Поиск поддоменов поможет при анализе продвигаемого сайта – для выявления всех его поддоменов, в том числе «забытых» по каким-то причинам, либо технических (тестовых), не закрытых от индексации, а также в целом для анализа крупных интернет-магазинов и порталов в части организации их структуры. Поиск основан на сконструированных определенным образом запросах к различным поисковым системам. Таким образом, поиск ведется только по разрешенным к индексации поддоменам искомого веб-ресурса.

- CMS-чекер

- Модуль предназначен для определения CMS сайта и группы сайтов в автоматическом онлайн режиме. Определение типа и названия CMS идет путем поиска определенных паттернов в исходном коде страниц сайта. Таким образом, данный сервис позволяет в один клик определить CMS, на которой работают десятки интересующих вас сайтов без изучения исходного кода страниц и специфики различных систем управления сайтами.

- Семантический анализ текста

- Данный семантический анализатор проводит анализ основных SEO-параметров текста, таких как: длина текста, количество слов, анализ плотности ключевых слов (тошнота), «вода» в тексте (водность).

- Анализ релевантности текста

- Данный инструмент предназначен для SEO-специалистов и позволяет провести подробный анализ контента интересующей страницы сайта на предмет ее релевантности произвольному поисковому запросу.

- Основные критерии, по которым страницу сайта можно назвать «готовой» к продвижению это: наличие тега h1, количество вхождений ключевого слова в TITLE и BODY, объем текста страницы, число точных вхождений запроса в текст и т.п.

Почти каждый из модулей дает возможность пакетной работы с доменами, а также возможность экспорта полученных данных в файл формата CSV или буфер обмена.

Более подробно ознакомиться с работой модуля "Анализ доменов" можно в статье SiteAnalyzer 2.8.

Основными способами веб-скрейпинга являются методы разбора данных используя XPath, CSS-селекторы, XQuery, RegExp и HTML templates.

Обычно при помощи скрейпинга решаются задачи, с которыми сложно справиться вручную. Это может быть извлечение описаний товаров для создании нового интернет-магазина, скрейпинг в маркетинговых исследованиях для мониторинга цен, либо для мониторинга объявлений.

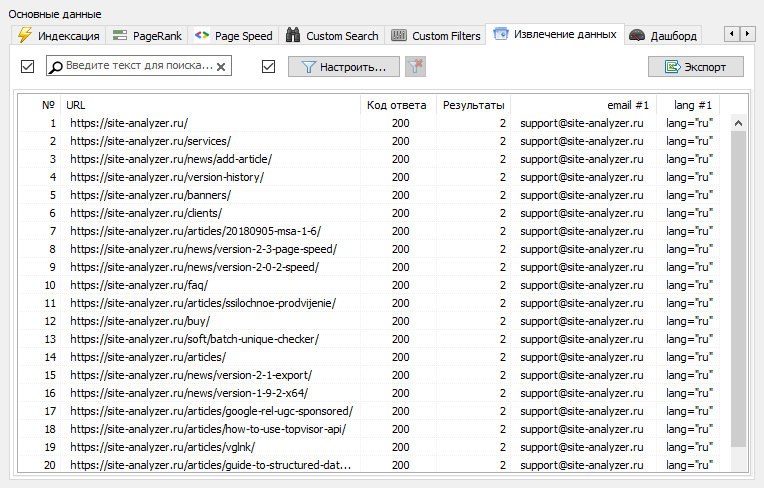

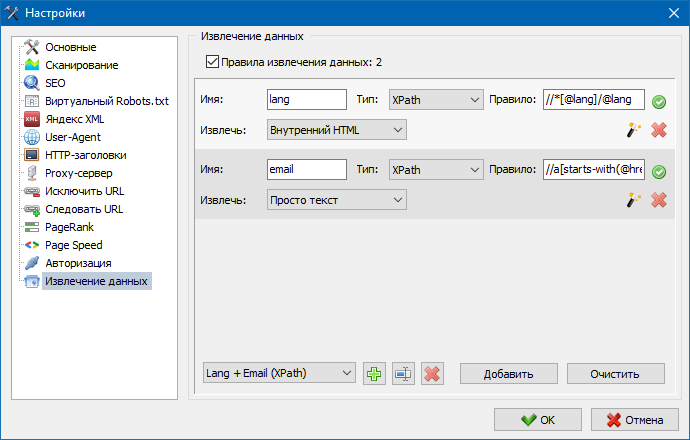

В SiteAnalyzer за настройку скрейпинга отвечает вкладка "Извлечение данных", в которой настраиваются правила извлечения. Правила можно сохранять и, при необходимости, редактировать.

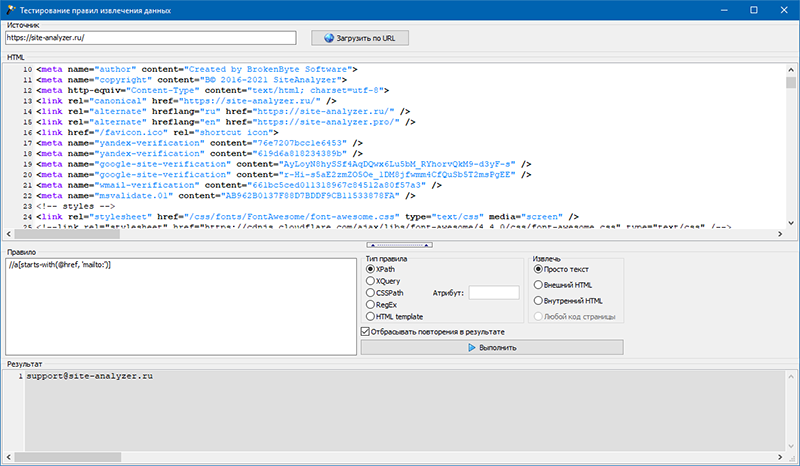

Также присутствует модуль тестирования правил. При помощи встроенного отладчика правил можно быстро и просто получить HTML-содержимое любой страницы сайта и тестировать работу запросов, после чего использовать отлаженные правила для парсинга данных в SiteAnalyzer.

После окончания извлечения данных всю собранную информацию можно экспортировать в Excel.

Более подробно изучить работу модуля и ознакомиться со списком наиболее часто встречающихся правил и регулярных выражений можно в статье Как бесплатно спарсить и извлечь данные с сайта.

Проверка уникальности контента

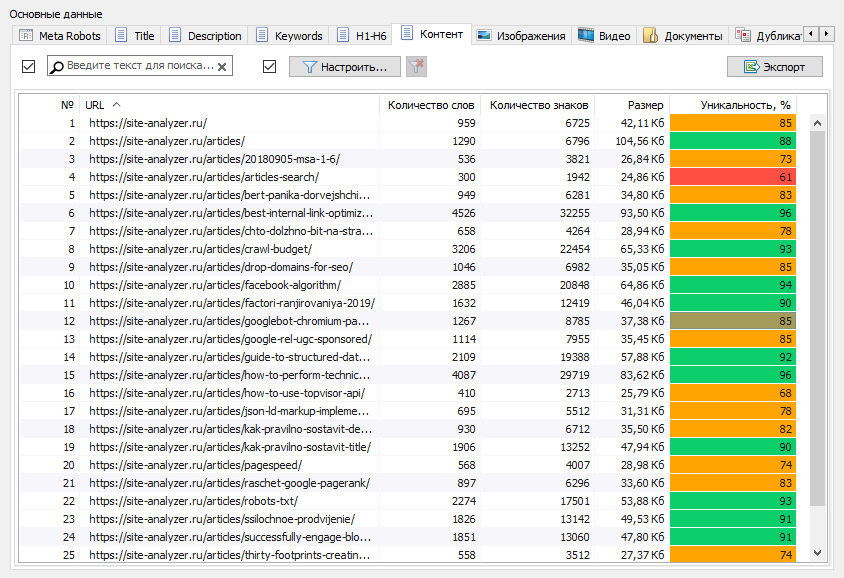

Данный инструмент позволяет провести поиск дубликатов страниц и проверить уникальность текстов внутри сайта. Иными словами это пакетная проверка группы URL на уникальность между собой.

Это может быть полезно в случаях:

- Для поиска полных дублей страниц (например, страница с параметрами и та же самая страница, но в виде ЧПУ).

- Для поиска частичных совпадений контента (например, два рецепта борща в кулинарном блоге, которые схожи между собой на 96%, что наводит на мысль, что одну из статей лучше удалить, дабы избавиться от возможной каннибализации трафика).

- Когда на статейном сайте вы случайно написали статью по теме, которую уже писали ранее 10 лет назад. В этом случае наш инструмент также выявит дубликат такой статьи.

Принцип работы инструмента проверки уникальности контента прост: по списку URL сайта программа скачивает их содержимое, получает текстовое содержимое страницы (без блока HEAD и без HTML-тегов), а затем при помощи алгоритма шинглов сравнивает их друг с другом.

Таким образом, при помощи шинглов мы определяем уникальность страниц и можем вычислить как полные дубли страниц с 0% уникальностью, так и частичные дубли с различными степенями уникальности текстового содержимого. Программа работает с длиной шингла равной 5.

Более подробно изучить работу модуля можно в статье Как массово проверить уникальность страниц между собой.

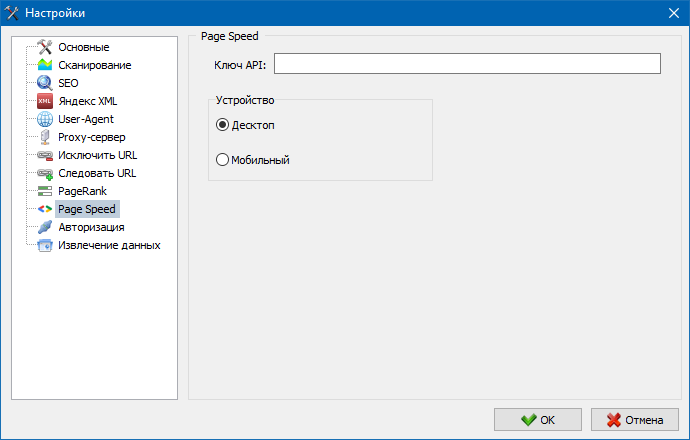

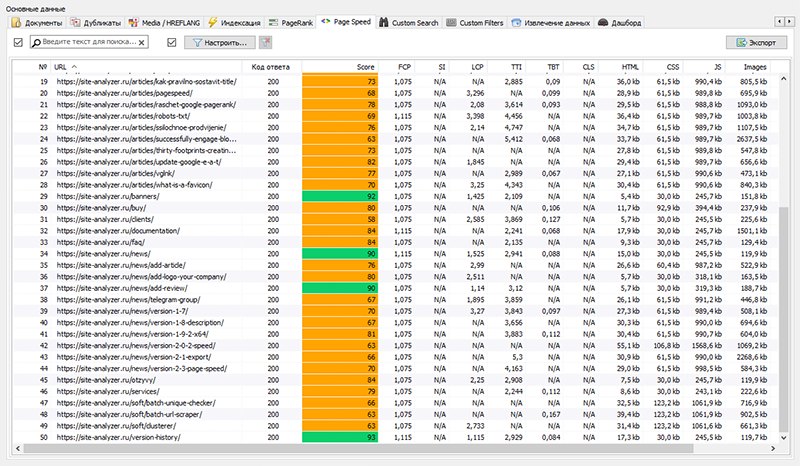

Проверка скорости загрузки страниц

Модуль позволяет бесплатно создавать групповые проверки скорости загрузки страниц через специальный API в инструменте Google PageSpeed Insights.

Основные анализируемые параметры:

- FCP (First Contentful Paint) – время отображения первого контента.

- SI (Speed Index) – показатель того, как быстро отображается контент на странице.

- LCP (Largest Contentful Paint) – время отображения наибольшего по размеру элемента страницы.

- TTI (Time to Interactive) – время, в течение которого страница становится полностью готова к взаимодействию с пользователем.

- TBT (Total Blocking Time) – время от первой отрисовки контента до его готовности к взаимодействию с пользователем.

- CLS (Cumulative Layout Shift) – накопительный сдвиг макета. Служит для измерения визуальной стабильности страницы.

Благодаря многопоточной работе программы SiteAnalyzer, проверка сотни и более URL может занять всего несколько минут, на что в ручном режиме, через браузер, мог бы уйти день или более.

При этом, сам анализ URL происходит всего в пару кликов, после чего доступна выгрузка отчета, включающего основные характеристики проверок в удобном виде в Excel.

Все что вам требуется для начала работы – получить ключ API.

Как это сделать – описано в данной статье.

Данный функционал предназначен для создания структуры сайта на основе спарсенных данных. Структура сайта генерируется исходя из вложенности URL страниц. После генерации структуры доступен ее экспорт в CSV-формат (Excel).

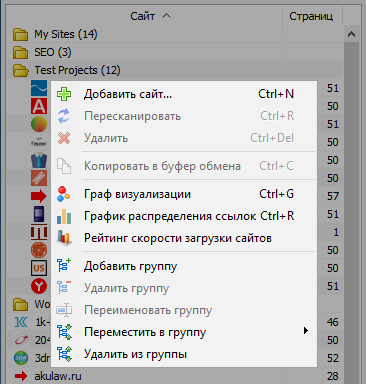

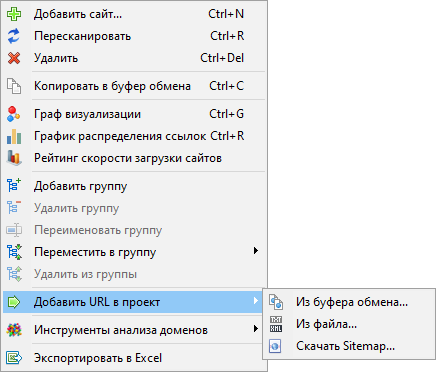

Контекстное меню списка проектов

- В списке проектов доступно массовое сканирование путем выделения нужных сайтов и нажатия кнопки "Пересканировать". После чего все сайты становятся в очередь и сканируются поочередно в стандартном режиме.

- Также, для удобства работы с программой, массовое удаление выбранных сайтов также доступно по кнопке "Удалить".

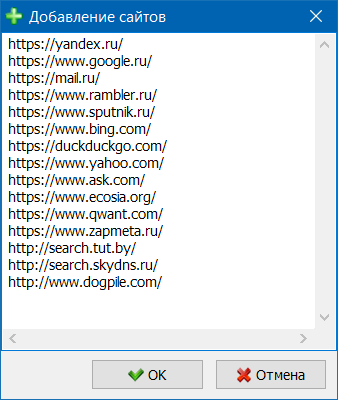

- Помимо единичного сканирования сайтов, существует возможность массового добавления сайтов в список проектов с помощью специальной формы, после чего пользователь может просканировать интересующие проекты целиком.

- Для более удобной навигации по списку проектов доступна возможность группировки сайтов по папкам, а также фильтрация списка проектов по названию.

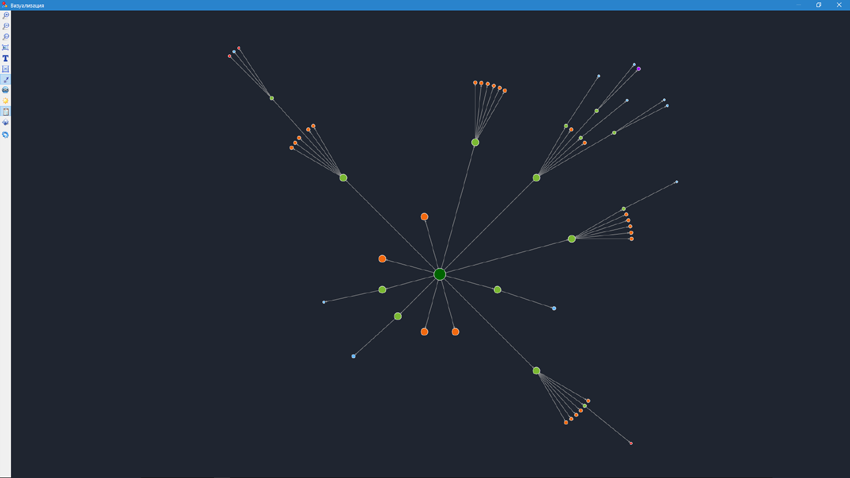

Режим визуализации ссылочных связей на графе поможет SEO-специалисту оценить распределение внутреннего PageRank на страницах сайта, а также понять, какие из страниц получают большую ссылочную массу (и соответственно, больший внутренний ссылочный вес в глазах поисковых систем), а каким страницам и разделам сайта не хватает внутренних ссылок.

При помощи режима визуализации структуры сайта SEO-специалист сможет наглядно оценить то, как организована внутренняя перелинковка на сайте, а также за счет визуального представления массы PageRank, присвоенной тем или иным страницам, оперативно вносить корректировки в текущую перелинковку сайта и тем самым повышать релевантность интересующих страниц.

В левой части окна визуализации находятся основные инструменты для работы с графом:

- изменение масштаба на графе

- поворот графа на произвольный угол

- переключение окна графа в полноэкранный режим (F11)

- отображение / скрытие подписей к узлам (Ctrl-T)

- отображение / скрытие стрелок у линий

- отображение / скрытие ссылок на внешние ресурсы (Ctrl-E)

- переключение режима цветовой схемы День / Ночь (Ctrl-D)

- отображение / скрытие легенды и статистики графа (Ctrl-L)

- сохранение графа в формат PNG (Ctrl-S)

- окно настроек визуализации (Ctrl-O)

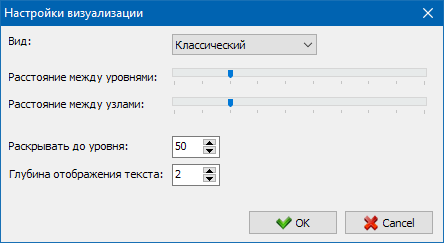

Раздел "Вид" предназначен для изменения формата отображения узлов на графе. В режиме рисования узлов "PageRank", размеры узлов устанавливаются относительно их ранее рассчитанного показателя PageRank, в результате чего на графе можно наглядно увидеть, какие страницы получают больший ссылочный вес, а каким достается меньше всего ссылок.

В классическом режиме размеры узлов устанавливаются относительно выбранного масштаба графа визуализации.

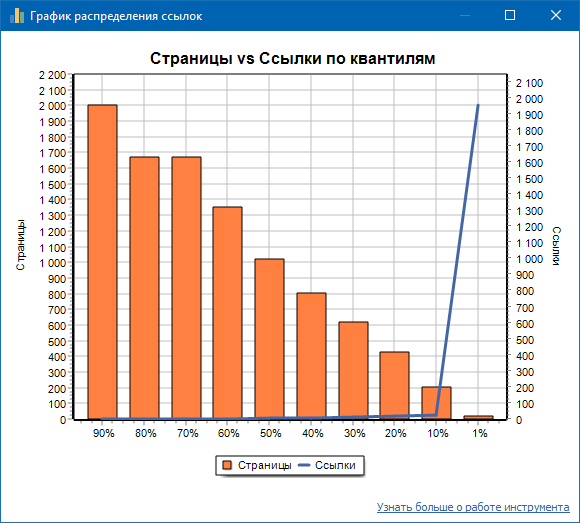

Данный график показывает распределение внутренней ссылочной массы на страницах сайта (можно сказать, что это визуализация перелинковки в наглядном виде, нежели она представлена на Графе визуализации).

Слева отображено число страниц, справа – число ссылок. Внизу – процентные квантили по страницам. При составлении графика дубликаты ссылок отбрасываются (если со страницы А на страницу Б ведет 3 ссылки, то мы их считаем за одну).

Например, исходя из скриншота выше, для сайта из порядка 70 страниц:

- 1% страниц имеют ~68 входящих ссылок.

- 10% страниц имеют ~66 входящих ссылок.

- 20% страниц имеют ~15 входящих ссылок.

- 30% страниц имеют ~8 входящих ссылок.

- 40% страниц имеют ~7 входящих ссылок.

- 50% страниц имеют ~6 входящих ссылок.

- 60% страниц имеют ~5 входящих ссылок.

- 70% страниц имеют ~5 входящих ссылок.

- 80% страниц имеют ~3 входящих ссылок.

- 90% страниц имеют ~2 входящих ссылок.

То есть, если мы видим, что у нас имеются страницы, на которые ведет менее 10 входящих ссылок, то такие страницы мы можем считать слабо залинкованными, а нормально залинкованных у нас 60% страниц. Исходя из этого, мы можем либо проставить больше внутренних ссылок на эти слабо залинкованные страницы (если страницы важны для продвижения), либо оставить как есть, если подобные страницы имеют малое значение и низкий приоритет.

На общей практике, страницы, имеющие менее 10 внутренних ссылок хуже краулятся поисковыми роботами, в частности, ботами Google.

Поэтому, если вы видите сайт, у которого нормально залинкованных всего 20-30% страниц от общего числа страниц на сайте, то имеет смысл углубиться в настройку перелинковки либо подумать, как поступить с этими 80-70% слабо залинкованных страниц (удалить, скрыть от индексации, поставить редиректы).

Пример слабо залинкованного сайта:

Пример хорошо залинкованного сайта:

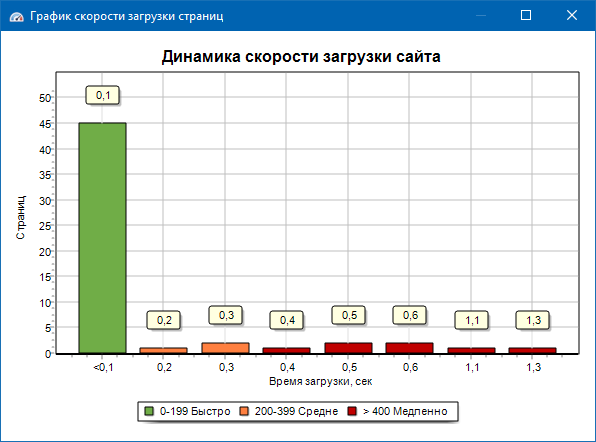

График скорости загрузки страниц

График скорости загрузки страниц позволяет оценить быстродействие сайта. Для наглядности, страницы распределены по группам и временным интервалам с шагом в 100 миллисекунд.

Таким образом, исходя из графика можно определить, какая доля страниц сайта грузится быстро (в пределах 0-100 миллисекунд), какая со средней скоростью (100-200 миллисекунд) и какие страницы загружаются достаточно долго (400 миллисекунд и более).

Примечание: указанное время является временем загрузки исходного кода HTML, а не временем полной загрузки страниц (рендеринг страницы, а также подгрузка элементов страницы, таких как, например, изображения и стили, не учитывается).

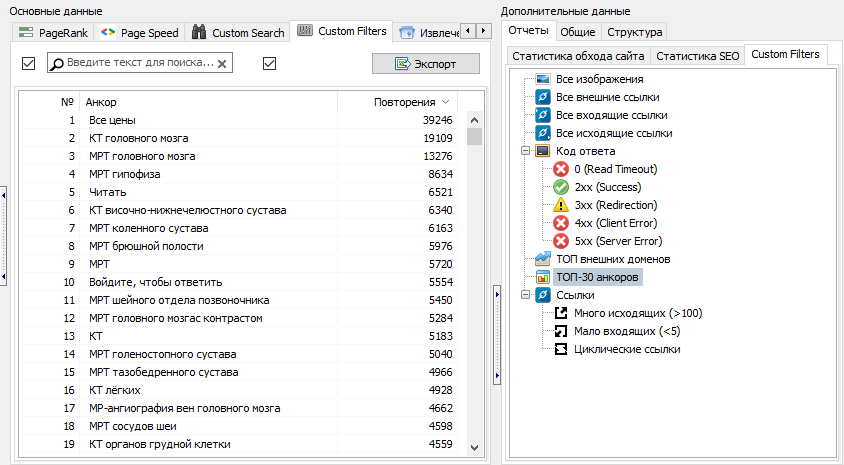

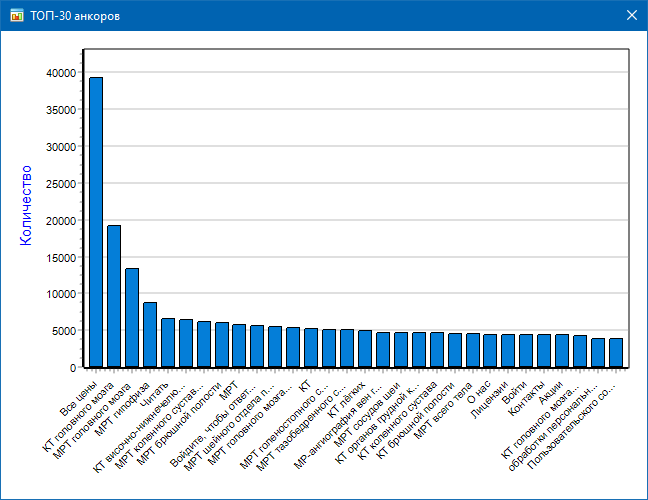

ТОП анкоров

Фильтр по ТОПу анкоров расположен на панели «Custom Filters», а также график плотности ключевых слов.

Для анализа берутся все анкоры ссылок с сайта (внешние и внутренние), считается число повторений каждого анкора и отображается в таблице и на графике (на графике отображаются 30 первых анкоров).

Экспорт в MindMap

Экспорт структуры сайта в майндкарты позволяет визуализировать текущую структуру сайта в виде удобных ментальных карт с возможностью их дальнейшего редактирования в четырех самых популярных редакторах: MindManager, Xmind, Mindmeister и Coggle.

Таким образом, теперь буквально за пару минут можно получить структуру сайта в виде интеллект карт в удобном визуальном формате и без лишних манипуляций.

Более подробно ознакомиться с работой пункта "Экспорт в MindMap" можно в обзорной статье SiteAnalyzer 2.9.

Генерация Sitemap.xml

Карта сайта генерируется на основе просканированных страниц либо изображений сайта.

- При генерации карты сайта, состоящей из страниц, в нее добавляются страницы формата "text/html".

- При генерации карты сайта, состоящей из изображений, в нее добавляются изображения JPG, PNG, GIF и тому подобных форматов.

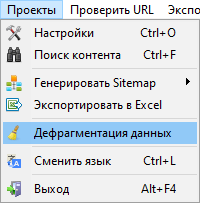

Сгенерировать карту сайта можно сразу после сканирования сайта, через главное меню: пункт "Проекты -> Генерировать Sitemap".

Для сайтов больших объемов, от 50 000 страниц, имеется функция автоматического разбиения "sitemap.xml" на несколько файлов (в этом случае основной файл содержит ссылки на дополнительные, содержащие непосредственно ссылки на страницы сайта). Это связано с требованиями поисковых систем для обработки файлов sitemap больших размеров.

При необходимости, объем страниц в файле "sitemap.xml" можно варьировать, изменив значение 50 000 (установлено по умолчанию) на нужное значение в основных настройках программы.

Виртуальное сканирование сайтов

Виртуальное сканирование «Virtual Crawl» реализовано за счет сканирования сайтов без использования базы данных за счет чего нивелируются потери при взаимодействии сканера с базой данных программы и сканирование происходит на порядок быстрее на медленных HDD или SSD дисках. Все данные при этом хранятся виртуально и доступны только во время запуска программы и до переключения на другой проект.

Виртуальное сканирование реализовано через переключатель, расположенный рядом с кнопками «Старт» и «Стоп» в верхней части программы.

- При отжатом переключателе, сайты сканируются в классическом режиме.

- При нажатом переключателе, сайты сканируются в режиме виртуального сканирования.

Плюсы и минусы режима «Virtual Crawl»:

- Минусом данного режима является то, что данные по проекту актуальны лишь на момент работы программы и до переключения на другой проект.

- При этом плюсом является быстрое добавление и анализ проекта, а также увеличение скорости сканирования на медленных HDD или SSD дисках.

- Результаты сканирования в режиме «Virtual Crawl» полностью дублируют функционал сканирования по списку проектов (фильтры, выборки, граф визуализации и т.п.).

Примечание. Режим «Virtual Crawl» доступен только на платном тарифе.

Сканирование произвольных URL

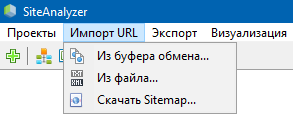

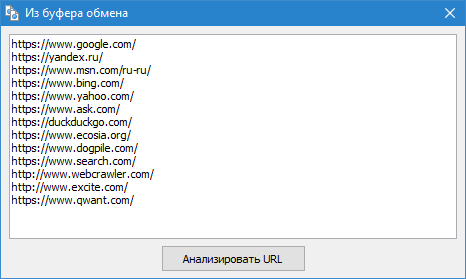

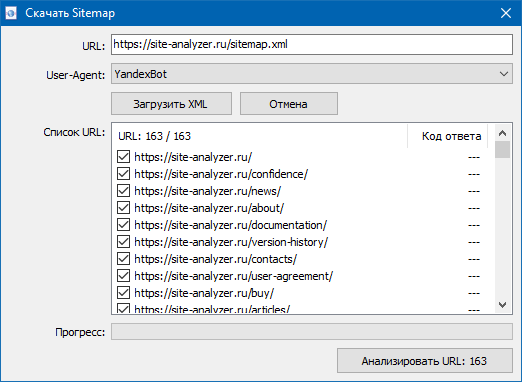

Пункт меню "Импорт URL" предназначен для сканирования произвольных списков URL, а также XML-карт сайта Sitemap.xml (в том числе и индексных) для их последующего анализа.

Сканирование произвольных URL возможно тремя способами:

- путем вставки списка URL из буфера обмена

- загрузкой с жесткого диска файлов формата *.txt и *.xml, содержащих списки URL

- путем скачивания файла Sitemap.xml непосредственно с сайта

Особенностью данного режима является то, что при сканировании произвольных URL сам "проект" не сохраняется в программе и данные по нему не добавляется в базу. Также не доступны разделы "Структура сайта" и "Дашборд".

Более подробно ознакомиться с работой пункта "Импорт URL" можно в обзорной статье SiteAnalyzer 1.9.

Дашборд

Вкладка "Дашборд", отображает подробный отчет о текущем качестве оптимизации сайта. Отчет генерируется на основе данных вкладки "Статистика SEO". Помимо этих данных в отчете присутствует указание общего показателя качества оптимизации сайта, рассчитываемого по 100-бальной шкале относительно текущей степени его оптимизации. Имеется возможность экспорта данных вкладки "Дашборд" в удобный отчет в формате PDF.

Импорт URL

Это бывает удобно, когда, например, у проекта уже просканировано большое число станиц, при этом на сайте добавилось несколько новых URL и мы хотим их проанализировать, но не хотим тратить время на долгое пересканирование всего сайта, чтобы увидеть недавно добавленные страницы.

Импорт URL в проект осуществляется через контекстное меню списка проектов, а также через контекстное меню списка URL – пункт «Добавить URL в проект».

Более подробно ознакомиться с работой пункта "Импорт URL" можно в обзорной статье SiteAnalyzer 2.9.

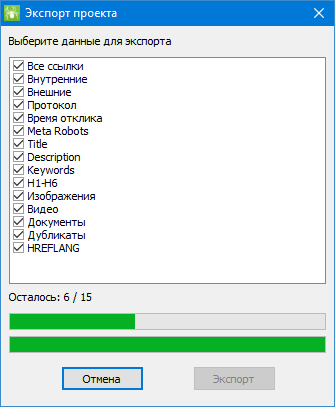

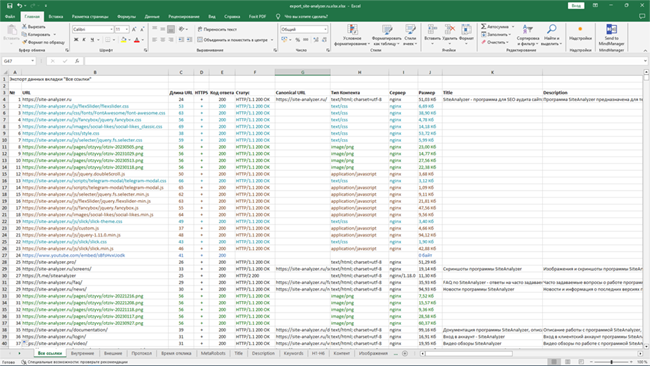

Экспорт данных

Для более гибкого анализа полученных данных имеется возможность их выгрузки в CSV-формат (экспортируется текущая активная вкладка), а также генерации полноценного отчета в Microsoft Excel со всеми вкладками в одном файле.

При экспорте данных в Excel появляется специальное окно, в котором пользователь может выбрать интересующие колонки и затем сгенерировать отчет с нужными данными.

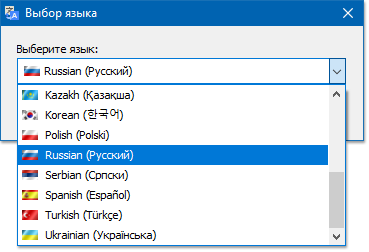

Мультиязычность

В программе имеется возможность выбора предпочтительного языка, на котором будет вестись работа.

Основные поддерживаемые языки: русский, английский, немецкий, итальянский, испанский, французский... На данный момент программа переведена на более чем пятнадцать (15) наиболее популярных языков.

Если вы хотите перевести программу на свой родной язык, то для этого достаточно перевести любой файл «*.lng» на интересующий язык, после чего переведенный файл нужно отправить на адрес «support@site-analyzer.ru» (комментарии к письму должны быть написаны на русском или английском языках) и ваш перевод будет включен в новый релиз программы.

Более подробная инструкция по переводу программы на языки находится в дистрибутиве (файл «lcids.txt»).

P.S. Если у вас есть замечания по качеству перевода – отправляйте замечания и исправления через форму обратной связи.

Дефрагментация данных

Пункт главного меню «Дефрагментация данных» предназначен для выполнения операции упаковки базы данных – чистка базы от ранее удаленных проектов, а также их упорядочивание (аналог дефрагментации данных на персональных компьютерах).

Данная процедура эффективна в случае, когда например, из программы был удален крупный проект, содержащий большое количество записей. В целом рекомендуется проводить периодическое сжатие данных для избавления от избыточных данных и уменьшения объема базы.

Тарифы

С ответами на остальные вопросы можно ознакомиться в разделе FAQ >>